Adobe et d’autres entreprises ont créé un symbole qui peut être attaché au contenu avec les métadonnées, établissant sa provenance, y compris s’il a été créé avec des outils d’IA.

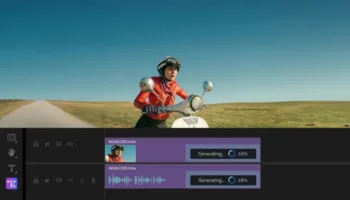

Ce symbole, que Adobe appelle « icône de transparence », peut être ajouté par les plateformes d’édition photo et vidéo d’Adobe, telles que Photoshop ou Premiere, et éventuellement via le générateur d’images Bing de Microsoft. Il sera ajouté aux métadonnées des images, des vidéos et des PDF pour indiquer qui est le propriétaire et le créateur des données. Lorsqu’un internaute regardera une photo en ligne, il pourra passer la souris sur la marque et ouvrir un menu déroulant contenant des informations sur la propriété de la photo, l’outil d’IA utilisé pour la créer et d’autres détails sur la production du média.

Adobe a développé ce symbole avec d’autres entreprises dans le cadre de la Coalition for Content Provenance and Authenticity (C2PA), un groupe qui cherche à créer des normes techniques pour certifier la source et la provenance des contenus.

Elle utilise les initiales « CR », qui signifient Content CRedentials, pour éviter toute confusion avec l’icône de Creative Commons. Les autres membres de la C2PA sont Arm, Intel, Microsoft et Truepic. La C2PA est propriétaire de la marque déposée du symbole.

Si le petit symbole est visible sur l’image, les informations et le symbole sont également intégrés dans les métadonnées, de sorte qu’ils ne seront pas supprimés par Photoshop.

D’autres entreprises collaborent

Adobe indique que d’autres entreprises de la C2PA commenceront à mettre en œuvre le nouveau symbole dans les mois à venir. Microsoft, par exemple, utilise un filigrane numérique personnalisé dans le contenu créé avec son générateur d’images Bing, mais utilisera bientôt la nouvelle icône. Les entreprises et les utilisateurs ne sont pas tenus d’adopter le symbole.

L’essor du contenu généré par l’IA a ravivé l’intérêt pour une méthode standard de démonstration de l’authenticité. En particulier, l’inquiétude suscitée par les images et les vidéos truquées. Plusieurs entreprises technologiques, dont Adobe, ont signé un accord non contraignant avec la Maison Blanche pour développer des systèmes de filigrane permettant d’identifier les données générées par l’IA.