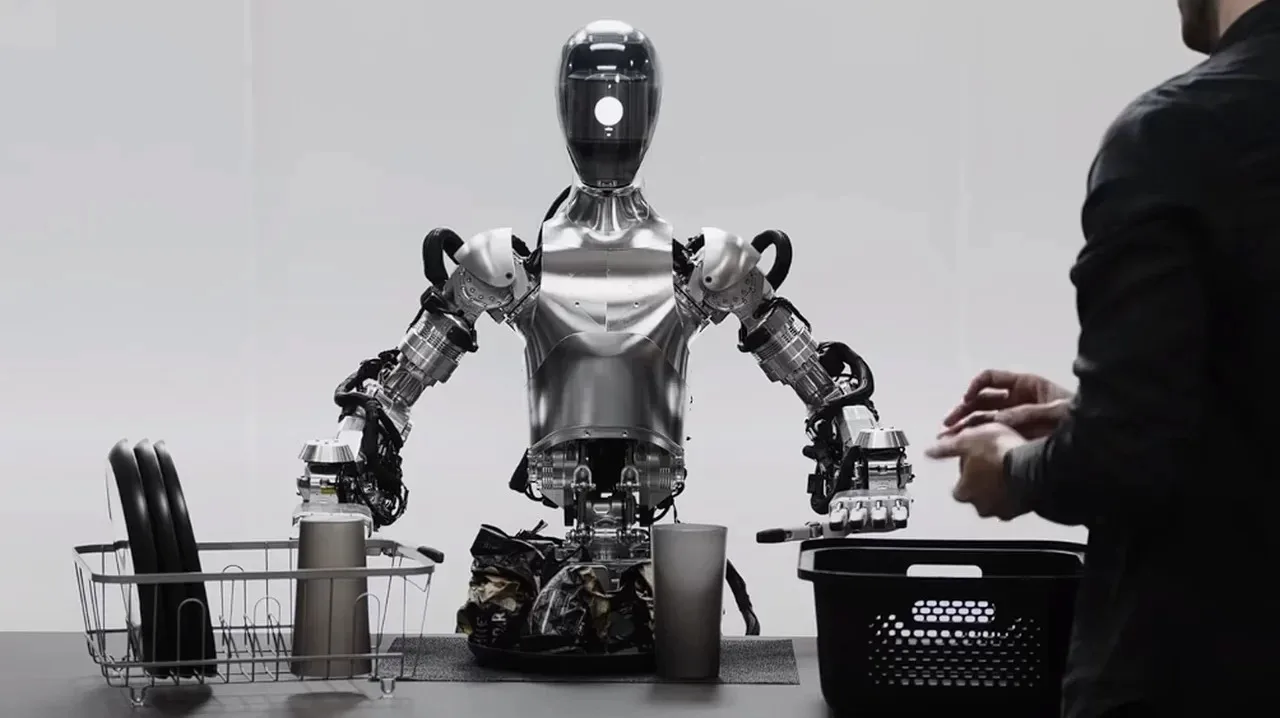

Imaginez un monde dans lequel des robots humanoïdes dotés d’une intelligence artificielle pourraient non seulement vous parler, mais aussi comprendre et interagir avec l’environnement qui les entoure, comme le ferait une personne. OpenAI, un laboratoire de recherche en IA de premier plan qui investit dans le développement de Figure 01, a fait un grand pas en avant avec sa dernière mise à jour de la technologie de synthèse vocale. Cette mise à jour représente un grand pas en avant dans la manière dont les systèmes d’IA comprennent le monde et s’y engagent, en les rapprochant d’une interaction semblable à celle des humains.

Cette nouvelle technologie ChatGPT a été déployée sur le robot humanoïde Figure 01, qui a désormais la remarquable capacité de reconnaître les objets qui l’entourent. Imaginez : une pomme rouge est posée sur une table et Figure 01 peut l’identifier avec précision. Cette capacité est essentielle pour que l’IA puisse interagir de manière significative avec son environnement.

Mais ce n’est pas tout. L’IA peut désormais répondre à des demandes en montrant qu’elle comprend ce dont vous avez besoin. Si vous avez faim et que vous demandez quelque chose à manger, Figure 01 peut voir que la pomme est de la nourriture et vous la proposer. Cela montre que l’IA ne se contente pas de reconnaître des objets, mais qu’elle comprend également leur utilisation dans notre vie quotidienne. Regardez la démonstration du robot humanoïde Figure 01 ci-dessous, qui a été amélioré avec ChatGPT Vision et ChatGPT Speech, nous donnant un aperçu d’un avenir qui approche à grands pas.

Le raisonnement de l’IA sur l’environnement s’est également beaucoup amélioré. Elle peut prédire ce qui se passera ensuite en fonction de ce qui se passe actuellement. Par exemple, elle sait qu’une fois la vaisselle lavée, il est probable qu’elle soit placée dans un égouttoir. Cette capacité à prédire et à planifier est une étape vers la capacité de l’IA à agir seule, sans que nous ayons besoin de la guider à chaque étape.

Lorsqu’il s’agit d’accomplir des tâches, l’IA est devenue plus indépendante. Si elle pense que la vaisselle doit être mise dans l’égoutoir, elle le fera d’elle-même. Cela montre que l’IA devient plus autonome et peut prendre des initiatives.

Des changements structurels

Autre nouveauté : l’IA peut désormais revenir sur ce qu’elle a fait et juger de son efficacité. Une fois qu’elle a terminé une tâche, Figure 01 peut décider si elle a atteint son objectif. Cette auto-évaluation est essentielle pour que l’IA apprenne de ses actions et s’améliore au fil du temps.

L’impact de la mise à jour de OpenAI est énorme. Il ne s’agit pas seulement de l’aspect technique, mais aussi de la façon dont l’IA s’intègre dans notre vie quotidienne. Grâce à de meilleures capacités de synthèse vocale, il sera plus naturel de parler et de travailler avec l’IA. À mesure que Figure 01 et d’autres systèmes d’IA s’améliorent, ils pourraient nous aider de bien des façons, que ce soit en nous facilitant la vie à la maison ou en changeant la façon dont les choses sont faites dans les industries.