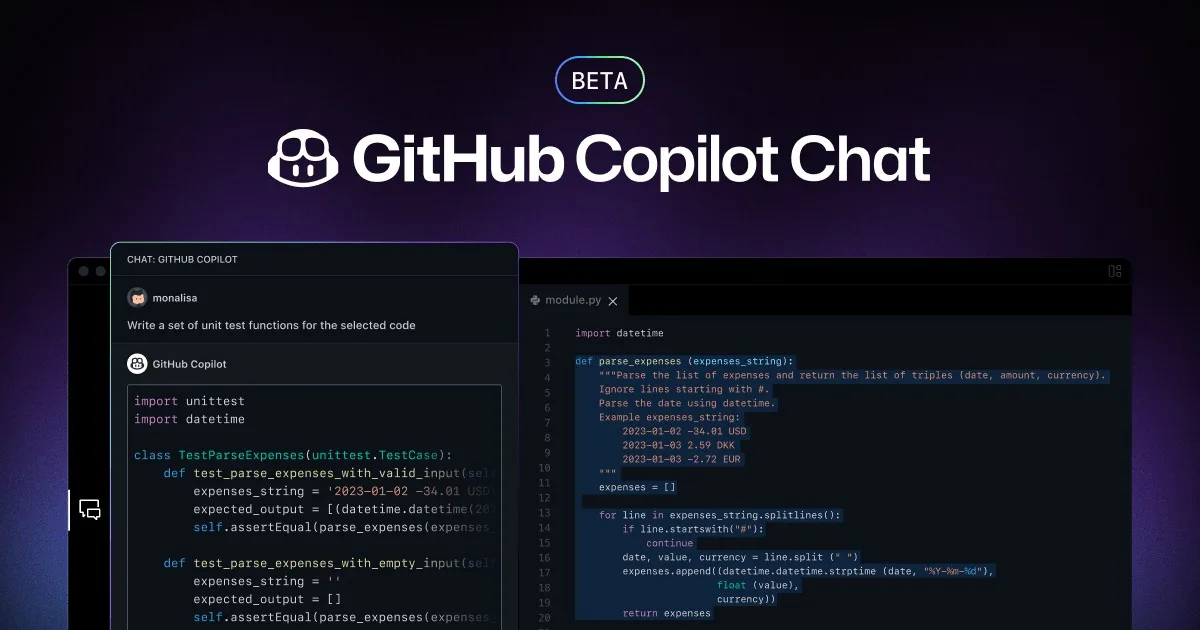

GitHub vient d’annoncer une amélioration majeure de son service Copilot Chat, permettant aux développeurs de choisir entre plusieurs Large Language Model (LLM) pour l’assistance en complétion de code.

Jusqu’à présent, Copilot Chat était exclusivement propulsé par GPT-4 d’OpenAI. Désormais, les développeurs ont la possibilité de basculer entre Claude 3.5 Sonnet d’Anthropic, Gemini 1.5 Pro de Google et plusieurs versions de GPT-4 d’OpenAI (GPT-4o, o1-preview et o1-mini).

Ce choix multi-modèles vise à offrir aux développeurs plus de flexibilité et de contrôle sur leurs workflows de développement assisté par IA. Le modèle Claude 3.5 d’Anthropic sera le premier à être disponible, suivi par le modèle Gemini de Google dans les prochaines semaines.

Pourquoi ce choix multi-modèles dans Copilot Chat ?

Certains observateurs pourraient interpréter cette évolution comme une tentative de GitHub, filiale de Microsoft, pour réduire sa dépendance à OpenAI. Toutefois, Thomas Dohmke, PDG de GitHub, précise que cette initiative vise avant tout à répondre aux besoins de choix des développeurs. Aucun modèle IA ne peut exceller dans toutes les tâches : chaque modèle a ses propres points forts et est mieux adapté à certaines langues et tâches de programmation spécifiques.

« Nous croyons vraiment que l’ère du modèle unique est révolue », explique Thomas Dohmke. GitHub utilisait déjà différentes versions des modèles GPT-3 et GPT-4 pour des tâches spécifiques, préférant des modèles plus petits et rapides pour des opérations à faible latence, et des modèles plus grands et précis pour une meilleure précision.

Cette capacité multi-modèles permet aux développeurs de sélectionner les modèles qui répondent le mieux à leurs politiques d’entreprise, aux benchmarks de leurs projets, aux langages utilisés et à leurs préférences personnelles.

Un partenariat stratégique avec Anthropic et Google

L’engagement de GitHub envers la fonctionnalité multi-modèles fait partie d’une stratégie plus large qui inclut des partenariats officiels avec Anthropic et Google. Thomas Kurian, PDG de Google Cloud, voit cette initiative comme une opportunité pour les développeurs d’accéder aux capacités d’IA de Gemini dans des environnements d’utilisation courants comme GitHub.

« Les développeurs souhaitent avoir un choix étendu de modèles adaptés au développement, incluant la génération de code, le refactoring et l’optimisation de code », déclare Kurian. Les modèles Gemini, optimisés pour les tâches de développement, sont maintenant accessibles à des millions de développeurs via GitHub.

Vers une sélection plus large de modèles dans l’écosystème GitHub

Pour l’instant, les options multi-modèles sont disponibles sur Copilot Chat et le nouvel outil Spark de GitHub. Cependant, GitHub prévoit d’étendre ce choix à l’ensemble de ses outils à l’avenir, permettant ainsi aux développeurs de tirer parti de la polyvalence des modèles IA dans diverses applications, allant de la génération de code et du refactoring à l’optimisation de code.

Cette approche multi-modèles de GitHub marque une avancée significative dans les outils de développement assistés par IA. En offrant les modèles Anthropic, Google et OpenAI au sein de Copilot Chat et, éventuellement, à l’ensemble de sa suite, GitHub permet aux développeurs de bénéficier d’une flexibilité inédite et d’une expérience de codage sur mesure.