Lors du dernier jour de l’événement “12 Days of OpenAI”, OpenAI a annoncé le lancement imminent de deux nouveaux modèles de raisonnement avancé : o3 et o3-mini. Successeurs des récents modèles o1 et o1-mini, ces modèles promettent d’atteindre de nouveaux sommets en matière de résolution de problèmes complexes en science, mathématiques, technologie et physique.

Le PDG d’OpenAI, Sam Altman, a révélé que ces modèles seront d’abord mis à disposition d’un groupe restreint de chercheurs tiers pour des tests de sécurité, avec une disponibilité progressive prévue dès janvier 2025.

o3, des capacités de raisonnement sans précédent

Les modèles o3 et o3-mini sont conçus pour gérer des tâches nécessitant un raisonnement complexe et transparent. Contrairement aux approches précédentes, le modèle o3 permet de suivre les étapes de son processus de réflexion grâce à des mécanismes documentés.

Selon Sam Altman, ces modèles représentent une nouvelle étape dans l’évolution des IA : « Pour conclure cet événement, nous voulions passer d’un modèle de pointe à un autre modèle encore plus avant-gardiste. Avec o3, nous entrons dans une nouvelle phase de l’IA où les modèles peuvent résoudre des tâches de plus en plus complexes ».

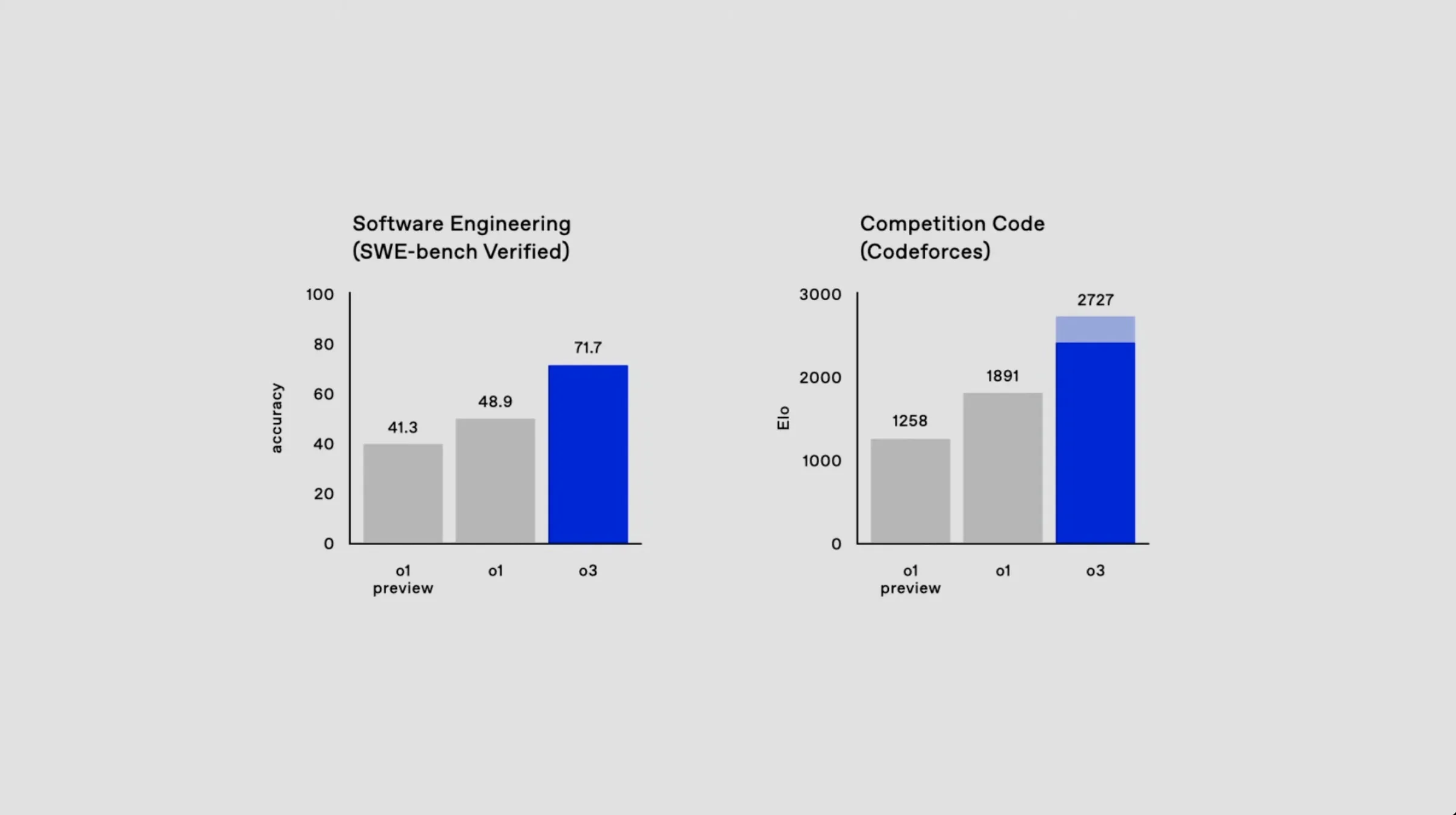

Les résultats des tests montrent des avancées significatives :

- Programmation de haut niveau : o3 dépasse les performances du modèle o1, avec un gain de 22,8 points sur le benchmark SWE-Bench Verified. Sur Codeforces, o3 atteint un score impressionnant de 2727, surpassant le Chief Scientist d’OpenAI, qui avait un score de 2665.

- Maîtrise des mathématiques et sciences : Le modèle a obtenu 96,7% sur l’examen AIME 2024 et 87,7% sur GPQA Diamond, dépassant les performances humaines.

- Résolution de problèmes conceptuels : o3 a établi de nouveaux records sur des tests difficiles, comme le Frontier Math d’EpochAI, résolvant 25,2% des problèmes, là où d’autres modèles atteignent à peine 2%. Sur le test ARC-AGI, o3 a triplé les scores du modèle o1 pour atteindre plus de 85%.

Alignement délibératif : une avancée en sécurité IA

Pour garantir que ces capacités avancées restent responsables, OpenAI mise sur une nouvelle méthode de sécurité appelée alignement délibératif.

Contrairement aux approches traditionnelles, comme l’apprentissage par renforcement basé sur des retours humains (RLHF) ou l’IA constitutionnelle, cette méthode intègre des spécifications de sécurité écrites par des humains directement dans les modèles. Ces spécifications permettent aux modèles de raisonner sur les politiques à respecter avant de générer des réponses.

Les résultats :

- Une meilleure résistance aux attaques de type “jailbreak”.

- Une réduction significative des refus excessifs pour des demandes bénignes.

- Une capacité accrue à généraliser les politiques de sécurité dans différents contextes, y compris en multilingue.

Cette méthode, qui a déjà démontré son efficacité avec le modèle o1, sera appliquée aux modèles o3 et o3-mini pour assurer un déploiement à la fois puissant et sécurisé.

Disponibilité et candidature pour tester o3 et o3-mini

OpenAI invite les chercheurs à postuler pour accéder aux modèles o3 et o3-mini via son site officiel. Les candidatures, ouvertes jusqu’au 10 janvier 2025, nécessitent des informations sur les projets de recherche, l’expérience passée, ainsi que des liens vers des publications ou des dépôts GitHub.

Les chercheurs sélectionnés pourront :

- Tester les capacités des modèles.

- Développer des évaluations rigoureuses.

- Créer des scénarios démontrant les risques et évaluer les performances sur des tâches complexes.

Une nouvelle phase pour l’intelligence artificielle

L’annonce d’o3 et o3-mini intervient dans un contexte de concurrence intense entre OpenAI et des acteurs comme Google, qui a récemment dévoilé son propre modèle de raisonnement, Gemini 2.0 Flash Thinking. Ces avancées marquent une étape importante dans le domaine de l’IA, où les modèles ne se limitent plus à répondre à des questions, mais sont capables de résoudre des problèmes conceptuels complexes.

En ouvrant l’accès aux chercheurs et en renforçant la sécurité, OpenAI vise à garantir un développement responsable de ces technologies de pointe.

Alors que 2025 s’annonce comme une année charnière pour l’IA, le lancement des modèles o3 pourrait redéfinir ce que l’on attend des intelligences artificielles modernes, notamment dans des domaines nécessitant un raisonnement précis et des performances sans faille.