Lors de la Google I/O 2024, Google a présenté Project Astra, un prototype révolutionnaire d’agents IA s’appuyant sur l’intelligence artificielle multimodale Gemini. Ce système innovant peut interpréter simultanément des entrées vidéo et vocales, réagissant intelligemment à l’environnement visuel de l’utilisateur et répondant à ses questions de manière contextuelle.

« J’ai cette vision en tête depuis un certain temps », déclare Demis Hassabis, directeur de Google DeepMind et chef de file des efforts de Google en matière d’intelligence artificielle. Hassabis réfléchit et travaille sur l’IA depuis des décennies, mais il y a quatre ou cinq ans, quelque chose s’est vraiment cristallisé. Un jour, il s’est rendu compte que « nous aurions un assistant universel. Il est multimodal et vous accompagne en permanence ». « C’est cet assistant », poursuit Hassabis, qui est tout simplement utile. « On s’habitue à ce qu’il soit là chaque fois qu’on en a besoin ».

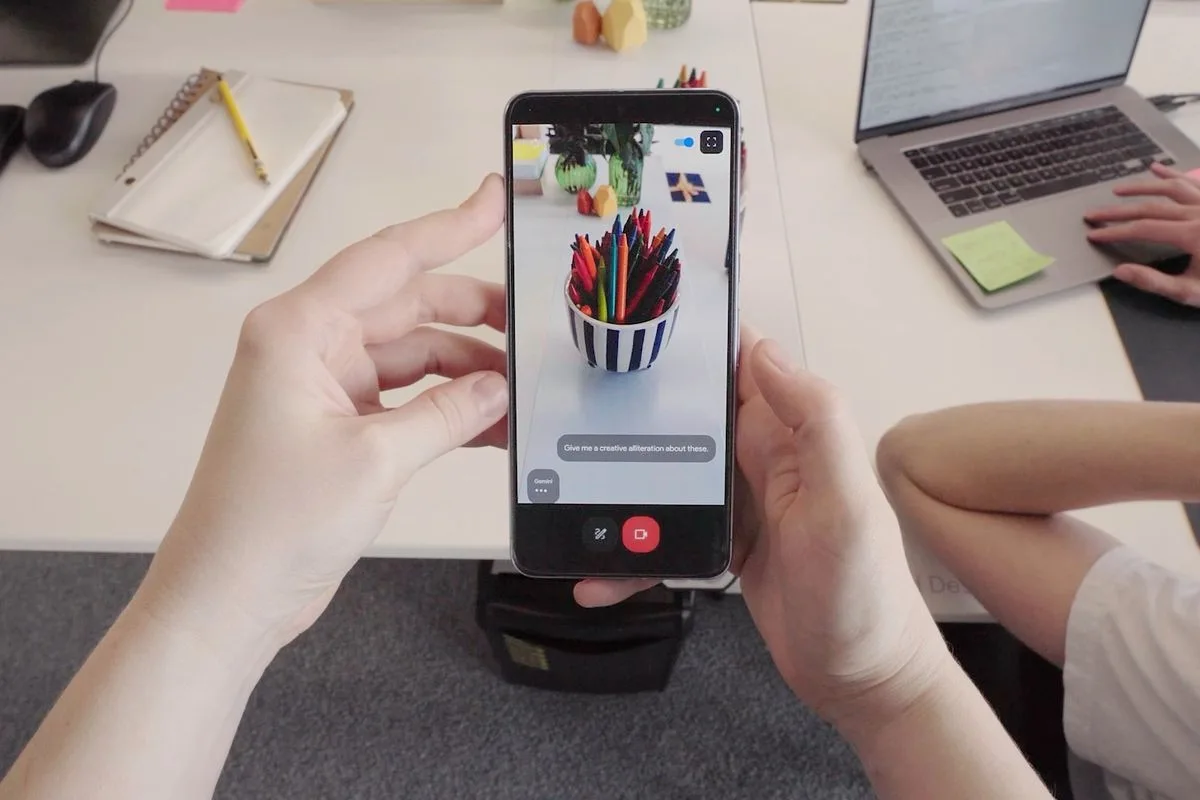

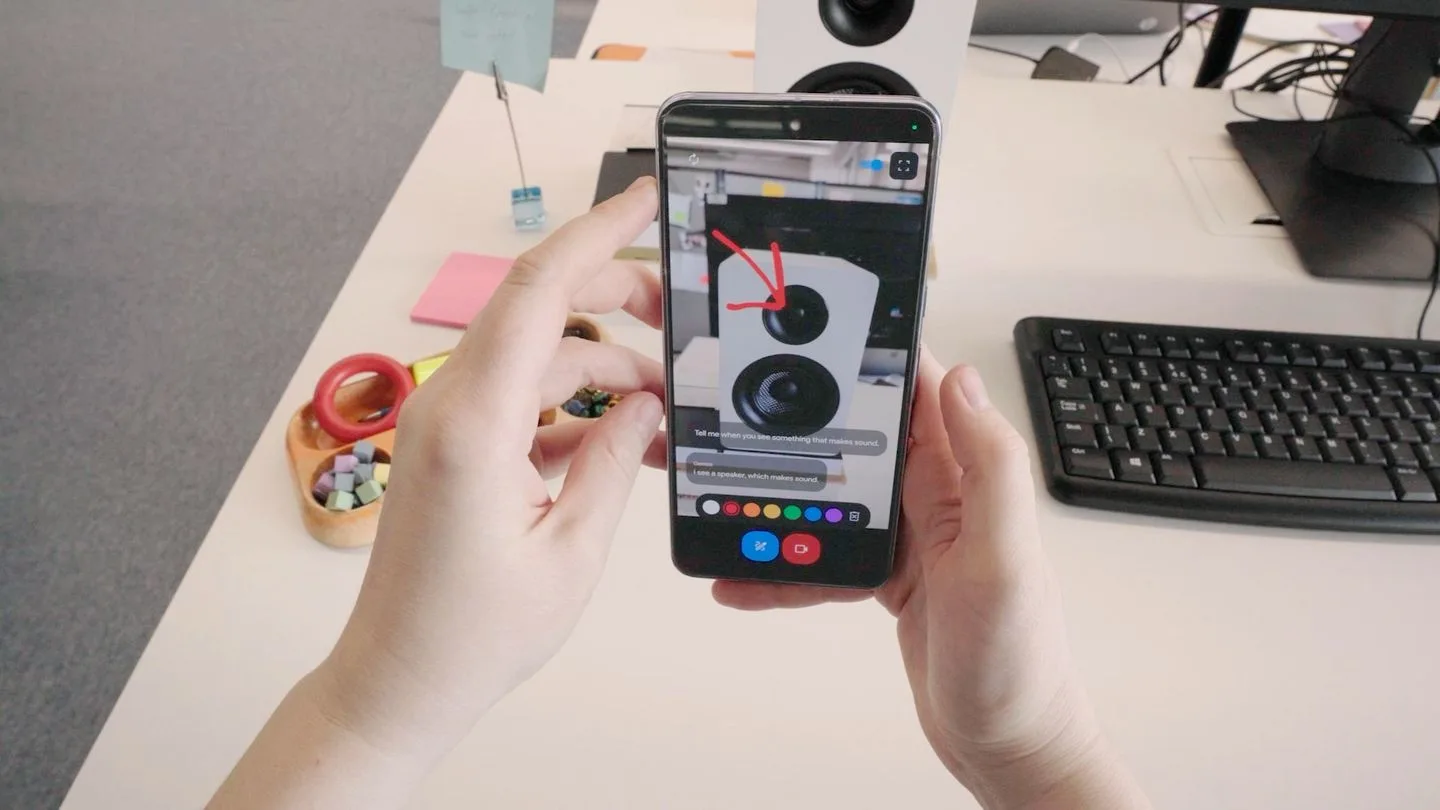

Project Astra vise à être un « IA universelle », utile au quotidien, proactive, éducable et capable de comprendre le langage naturel. Dans une démonstration, Google a montré comment cette technologie fonctionne avec un Pixel 8 Pro. En pointant la caméra du téléphone vers une pièce, l’IA a pu identifier un haut-parleur et expliquer que le composant visible était un tweeter, gérant les hautes fréquences.

Au-delà de cette capacité, Astra peut identifier du code sur un écran et en expliquer la fonction, décrire un lieu dans une ville, ou même créer des phrases allitératives. De plus, Astra peut se souvenir de l’emplacement d’objets, comme une paire de lunettes, en mémorisant les cadres vidéo qu’elle a vus, combinés à des entrées vocales, pour reconstruire et rappeler ces informations rapidement.

La démonstration a également inclus Google Glass, illustrant comment Astra pourrait améliorer l’utilité de ces lunettes connectées. En regardant un schéma sur un tableau blanc, l’IA était capable de proposer des optimisations.

Pas encore de date de lancement pour le Project Astra

Ce projet utilise une IA multimodale, qui combine des données de différentes sources — caméras, microphones et connaissances préalablement acquises — pour améliorer l’interaction et la réactivité de l’IA.

Bien que Google n’ait pas précisé quand Project Astra serait disponible pour le grand public ou les développeurs, Demis Hassabis a mentionné que certaines de ces capacités seraient intégrées dans les produits Google, comme l’application Gemini, plus tard dans l’année. Il est plausible de s’attendre à voir ces innovations intégrées dans la série Pixel 9.

Il est important de noter que malgré une présentation très fluide, la réalité de ces agents IA embarqués peut être entravée par la latence. Néanmoins, cette initiative offre un aperçu prometteur de l’intégration future d’outils IA véritablement utiles dans les produits Google.